This post is also available in:

מי שמכונים "הסנדקים של הבינה מלאכותית" מודאגים מהקצב בו היא מתפתחת ומזהירים משימוש זדוני.

פרופ' יהושע בנג'יו המכונה אחד מסנדקי הבינה המלאכותית אמר ל-BBC שהוא מרגיש "אבוד" בכל הנוגע למפעל חייו. הפרופסור הצטרף לאחרונה למומחים הקוראים לרגולציה של בינה מלאכותית, וטען שאסור לאפשר לכוחות צבאיים גישה לטכנולוגיה. פרופ' בנג'יו העלה את חששותיו, ואמר שהיה מתעדף בטיחות מעל יעילות אם היה חוזה את הכיוון והמהירות בהם מתפתחת הבינה המלאכותית.

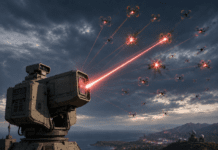

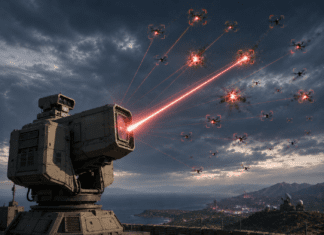

יש החוששים משימוש בבינה מלאכותית מתקדמת למטרות זדוניות כמו פיתוח נשקים קטלניים. באותו ריאיון פרופ' בנג'יו אמר: "זה יכול להיות צבא, זה יכול להיות טרוריסטים, זה יכול להיות מישהו מאוד כועס, פסיכוטי. ואם יהיה קל לתכנת את המערכות האלה ולבקש מהן לעשות משהו רע מאוד, זה עלול להיות מאוד מסוכן. אם הן חכמות מאיתנו, יהיה לנו קשה לעצור את המערכות האלה או למנוע נזק".

דר' ג'פרי הינטון, "סנדק" נוסף של הבינה המלאכותית, חתם עם פרופ' בנג'יו על שתי הצהרות הקוראות להישמר מהסכנות העתידיות של הבינה המלאכותית. דר' הינטון עזב לאחרונה את משרתו בגוגל ואף אמר שהוא מתחרט על פועלו.

אקדמאים ומומחים רבים מהתעשייה הזהירו שקצב התפתחות הטכנולוגיה עלול להיגמר בכך שגורמים שליליים ישתמשו בבינה מלאכותית כדי לגרום נזק מכוון- או שהבינה המלאכותית תבחר בעצמה לגרום נזק.

מצד שני, יש עוד "סנדק" של הטכנולוגיה שלא כל כך מודאג. פרופ' יאן לה-קון, מדען מחשבים צרפתי ומוביל בתחום הבינה המלאכותית טען שהאזהרות האפוקליפטיות והפאניקה מוגזמים ויצאו מפרופורציה.

ישנן דוגמאות רבות ליישומים שימושיים של בינה מלאכותית בחברה, אבל אל לנו להתעלם מאזהרות המומחים. הטכנולוגיה החדשה הזאת מאוד מרגשת ומהפכנית, אבל כפי שאמר פרופ' בנג'יו ל-BBC, יש לבצע רישום של כל החברות הבונות מוצרי בינה מלאכותית מתקדמת.