This post is also available in:

כחלק מהמאמץ הנוכחי להילחם בשטף המידע המזויף שנוצר על ידי בינה מלאכותית ותמונות deepfakes, חברות טכנולוגיה מובילות כמו גוגל, meta, OpenAI ואחרות הסכימו להוסיף חותמת (watermark) לתוכן שנוצר על ידי בינה מלאכותית, כך דווח על ידי הבית הלבן.

החברות התחייבו מול הבית הלבן שיישמו אמצעים מבדילים כמו חותמות על תוכן שנוצר על ידי בינה מלאכותית כדי לסייע להפוך את הטכנולוגיה לבטוחה יותר. בנוסף התחייבו לבחון מערכות ביסודיות לפני שחרורן, ולשתף מידע על איך להפחית סיכונים ולהשקיע באבטחת סייבר.

מאז שיישומי בינה מלאכותית כמו ChatGPT הפכו לזמינים לציבור וכבשו את העולם בסערה, מחוקקים רבים ברחבי העולם שקלו כיצד לנהל את הסכנות שהטכנולוגיה המתפתחת משקפת לביטחון הלאומי ולכלכלה.

כפי שדיווחנו בעבר, מחוקקים באיחוד האירופי עובדים על סדרה של כללי טיוטה על פיהם מערכות כמו ChatGPT יצטרכו לחשוף תוכן שנוצר על ידי בינה מלאכותית ולעזור להבחין בין תמונות דיפ-פייק לבין תמונות אמיתיות. הקונגרס האמריקאי שוקל כעת הצעת חוק שתדרוש ממודעות פוליטיות לחשוף האם נעשה שימוש בבינה מלאכותית כדי ליצור חלק מהתוכן.

על פי Cybernews, החברות התחייבו לפתח מערכת על מנת "לסמן" את כל צורות התוכן, כולל טקסט, תמונות, אודיו ווידאו, על מנת ליידע את המשתמשים כאשר היה שימוש בטכנולוגיה.

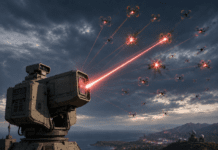

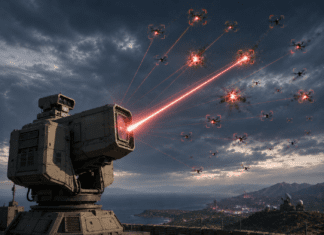

סימון זה יהיה מוטבע בתוכן באופן טכני, ומיועד להקל על המשתמשים לזהות דיפ-פייק בתמונות או אודיו העשויות להציג תמונות מטעות של אירועים שכלל לא התרחשו. כרגע לא ברור כיצד יוצג הסימן בעת שיתוף המידע.

חברות אלה התחייבו גם להתמקד בהגנה על פרטיות המשתמשים בעת פיתוח הבינה המלאכותית, ולהבטיח שהטכנולוגיה תהיה נקייה מהטיות ולא תשמש להפלות קבוצות פגיעות.